Tecnología

Otra vez la estafa por WhatsApp: hackean cuentas con el logo de la app Cuidar y un “cuento” sobre vacunas

Publicado

3 años atráson

Por

Admin

Los ciber delincuentes se apropian de esta manera de la libreta de contactos y usan la identidad de la víctima para pedir dinero prestado. Cómo detectarlo y la importancia de la seguridad de la “verificación en dos pasos” para impedir el robo

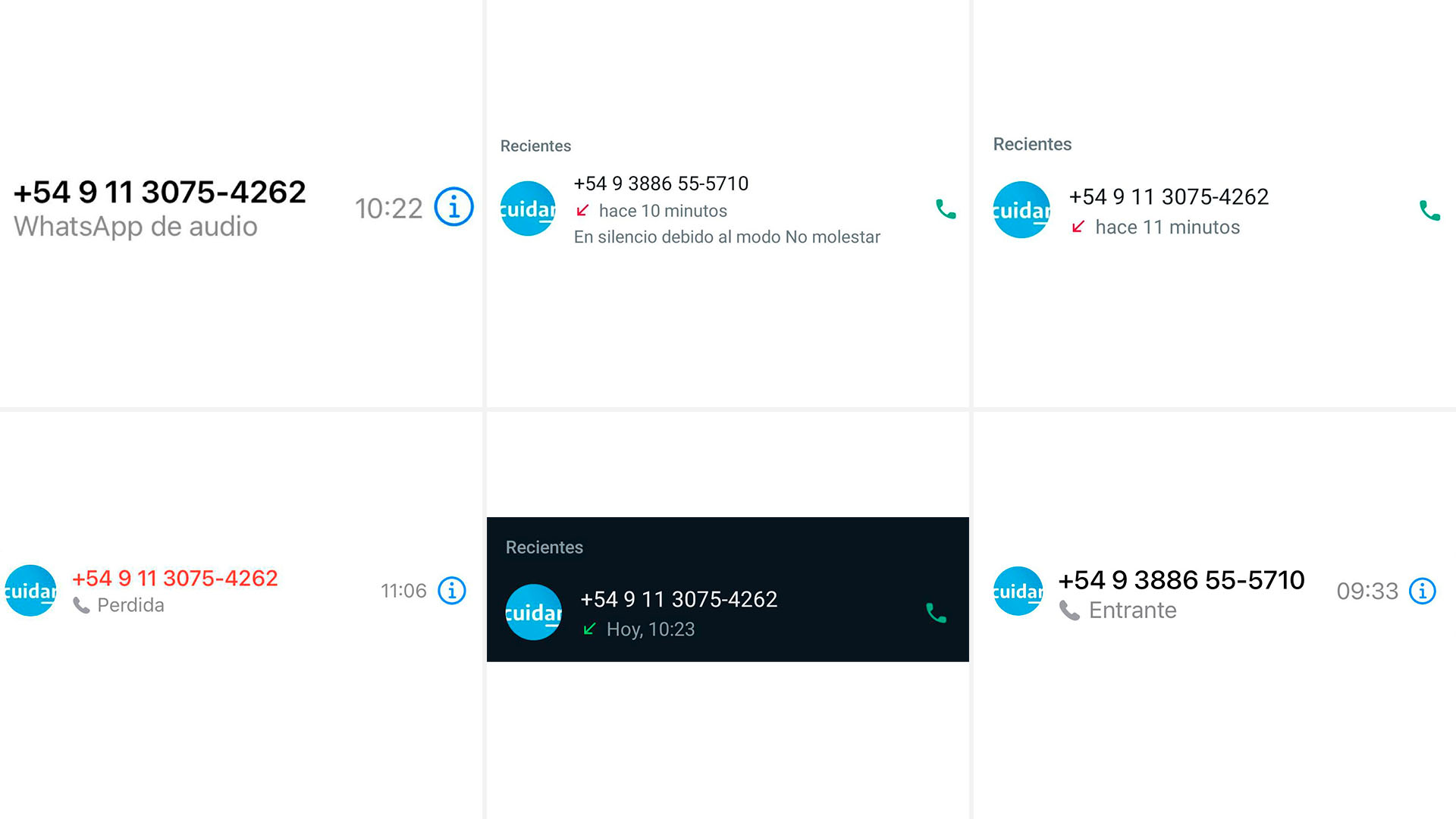

“Recién me llamaron por Whatsapp de ‘Cuidar’, diciéndome que me tenían que mandar el certificado nuevo de las vacunas, les seguí la corriente porque sabía que era una estafa”, contó un contacto en un grupo de trabajo y de inmediato casi una decena más dijo que le había pasado lo mismo. La novedad de esta vieja modalidad de intento de estafa es que la llamada tiene el logo de esa aplicación, tan necesaria y usada cuando comenzó la campaña de vacunación contra el coronavirus.

Es justamente esa la pata que los estafadores encontraron esta vez para acudir a los llamados que buscaban preocupar a los receptores: “Hablamos desde el Ministerio de Salud para saber si completó la cuarta y quinta dosis de la vacuna contra la COVID”, dijo una persona que se presentó como médico en otra llamada.

¿Qué buscan? Hacer creer a la persona que necesitará un nuevo carnet de vacunas, que claramente no tiene, y la convencen para que lo acepte, para esto le piden datos personales y luego inicia el intercambio de números que ellos usarán.

Las llamadas que recibieron integrantes de un mismo grupo de WhatsApp

Las llamadas que recibieron integrantes de un mismo grupo de WhatsApp“El ciberdelincuente ingresa el número telefónico al que la cuenta de WhatsApp está asociada en un dispositivo nuevo y envía el código de verificación a la línea asociada a esa cuenta, ya sea por SMS o por llamada telefónica, claro que sin que el dueño de la cuenta lo sepa. Si se trata de una mensaje de texto, los delincuentes suelen enviar un mensaje por WhatsApp o llamar por teléfono al dueño de la cuenta y fingir ser de una empresa o de algún organismo oficial, como el Ministerio de Salud. En medio del engaño, el estafador generalmente le pide al usuario ese código que llegó por SMS con alguna excusa, como ‘validar la identidad’, para ‘facilitar’ el trámite”, explica Emiliano Piscitelli, especialista en Seguridad Informática.

“El objetivo de los ciberdelincuentes somos todos”, aseguraron en octubre de 2020 los expertos en ciber seguridad durante una conferencia virtual en la que presentaron el estudio “COVID-19 – CIBERPANDEMIA: la otra cara de la crisis sanitaria”, según el cual —afirmaban— la industria del ciberdelito creció exponencialmente desde la llegada del virus.

Cómo estafan por WhatsApp

Cuando se instala por primera vez la app WhatsApp en un celular o si se la reinstala en otro dispositivo, la misma App envía un código de verificación para hacerlo efectivo. Este paso es justamente el que utilizan en mayor medida los estafadores para instalar una cuenta de un usuario en otro dispositivo y así robar todos sus contactos.

Aunque para la posible víctima la modalidad es nueva, ésta ya tiene unos años y lo único que varía es la “excusa” que encuentran para llegar al usuario al que buscan robar la identidad por medio de su cuenta. Una vez que se apoderan, van por todos sus contactos con el objetivo de engañarlos y obtener dinero.

Fue justamente durante la pandemia, en plena campaña de vacunación contra el coronavirus, que comenzaron a circular las estafas en esta app para conseguir este código con la excusa de confirmar o empadronar un turno para la vacuna.

“Puede pasar que una persona conocida o no, te diga que por equivocación puso tu número para recuperar su cuenta de WhatsApp, y que si te llegó un SMS, le pases el número y así de simple, en cuestión de minutos, otra persona se apodera de tu cuenta de WhatsApp y de todos nuestros contactos”.

Además, duplican la tarjeta SIM de los teléfonos celulares engañando de esa manera a las operadoras telefónicas para obtenerlo a nombre de otra persona, lo que hace todavía más fácil la estafa por WhatsApp, ya que el código de verificación llega de manera directa al nuevo dispositivo con la nueva línea.

El único fin que tiene esta modalidad es engañar a la lista de contactos y extraerles dinero. Hay unas tres grandes modalidades de estafa. Una es la de tomar la identidad de la víctima, decirle que habla de un nuevo número y que necesita un préstamo, por ejemplo.

La importancia de la verificación en dos pasos (Freepik)

La importancia de la verificación en dos pasos (Freepik)La verificación en dos pasos

Una de las maneras más efectivas de evitar caer en esta artimaña es “activar la verificación en dos pasos, configurar la privacidad (solo dar visibilidad a contactos o a nadie)”, según el experto.

“Es un número también de 6 dígitos que no hay que compartir con nadie, tiene que ser privado”, dijo sobre la opción que se encuentra en los ajustes de la propia app (los tres puntitos a la derecha, en Android y abajo en iPhone). Este numero es adicional al otro, por eso son dos pasos. El otro paso es poner un correo para recuperarlo en caso de olvidar ese número. Entonces es este número más el que llega por SMS. Activarlo es una manera de protegerse, pero es importante saber que nadie llamará para pedirles datos personales por teléfono y que en caso de recibir el llamado, no hay que darles nada”.

También recomienda que, en caso de ser víctima, se debe hacer la denuncia ante la autoridad judicial correspondiente por delitito informativo y reportar este incidente a support@whatsapp.com con el asunto: “Pérdida/Robo: desactivar mi cuenta”.

“No olvidemos que harán estafas con tu cuenta y a tu nombre, por eso es importante denunciar cuando se fue víctima de este tipo de estafa”, agrega.

Te sugerimos

Tecnología

Sam Altman advierte sobre la transformación en el empleo tras el avance de la inteligencia artificial

Publicado

6 meses atráson

19 junio, 2025Por

Admin

El CEO de OpenAI señaló que la llegada de sistemas superinteligentes cambiará la naturaleza de muchos empleos, aunque confía en la capacidad de adaptación de la sociedad ante estos cambios

Sam Altman, director ejecutivo de OpenAI, aseguró durante una conversación con su hermano Jack Altman, en el pódcast “Uncapped” que “la IA descubrirá nueva ciencia. Y esto es una afirmación loca, pero creo que es verdad”. Con esta frase, Altman anticipó el potencial transformador de la inteligencia artificial en los próximos años, delineando los retos y oportunidades que marcarán el rumbo de la sociedad y la economía global. Según detalló en el diálogo recogido en “Uncapped”, la IA está a punto de dar un salto cualitativo que podría revolucionar la ciencia, el empleo y la vida cotidiana, planteando interrogantes sobre la integración de sistemas superinteligentes y la competencia entre gigantes tecnológicos como OpenAI y Meta.

El potencial de la IA para descubrir nueva ciencia

Durante la entrevista, Sam Altman subrayó que la capacidad de razonamiento de los modelos de IA ha avanzado a un ritmo inesperadamente rápido. “Hemos resuelto el razonamiento en los modelos. Nos queda mucho camino por recorrer, pero creo que sabemos qué hacer”, afirmó el CEO de OpenAI, según recogió el pódcast.

El directivo sostuvo que, aunque la IA todavía actúa como copiloto en la investigación científica, su impacto ya se percibe en la productividad de los científicos. “Ya hay científicos que dicen que son tres veces más productivos usando O3”, relató Altman a “Uncapped”. A medida que los modelos evolucionen, anticipa que la IA podrá realizar descubrimientos autónomos, especialmente en campos con grandes volúmenes de datos, como la astrofísica. “He escuchado que la primera área donde la IA hará descubrimientos autónomos será la astrofísica, porque hay montañas de datos y no suficientes doctorados para analizarlos”, explicó.

A su juicio, la física representa un problema “más limpio” para la IA que la economía, por la naturaleza de los datos y la posibilidad de experimentación controlada.

Impacto en el empleo, la economía y la vida cotidiana

El avance de la inteligencia artificial no solo promete acelerar el progreso científico, sino que también tendrá efectos profundos en el mercado laboral y la economía. “Muchos trabajos desaparecerán. Muchos trabajos cambiarán drásticamente”, advirtió Altman en el pódcast. No obstante, el CEO de OpenAI se mostró optimista sobre la capacidad de la sociedad para adaptarse a estos cambios. “Siempre hemos sido muy buenos encontrando nuevas cosas que hacer y formas de ser útiles unos a otros”, reflexionó.

Altman reconoció que la transición podría resultar extraña desde la perspectiva actual, pero consideró que la humanidad ha atravesado transformaciones similares en el pasado. “A nosotros, nuestros trabajos nos parecen importantes y satisfactorios, pero si en el futuro todos estamos creando mejor entretenimiento para los demás, quizá eso sea lo que uno de nosotros ya está haciendo ahora”, comentó, en referencia al propio formato del pódcast.

En cuanto a la vida cotidiana, el ejecutivo prevé que los consumidores demandarán asistentes personales de IA, capaces de conocer sus objetivos y ayudarlos a través de múltiples dispositivos y plataformas. “Lo que los consumidores quieren de nosotros es, eventualmente, un compañero de IA, por falta de una mejor palabra, que viva en el éter y les ayude en todas estas formas”, describió.

Riesgos y desafíos de la superinteligencia y la integración física

El desarrollo de sistemas superinteligentes y su integración en el mundo físico representan, para Altman, uno de los mayores retos de la próxima década. El CEO de OpenAI reconoció que, aunque el software ha avanzado rápidamente, la robótica y la interacción física aún presentan desafíos significativos. “Estamos atrasados, pero creo que llegaremos. Por ejemplo, tenemos tecnología nueva que podría hacer conducción autónoma mucho mejor que cualquier enfoque actual”, señaló.

El empresario tecnológico se mostró convencido de que en cinco a diez años existirán robots humanoides avanzados, capaces de realizar tareas cotidianas en entornos urbanos. “Tendremos robots humanoides increíbles. Caminarán por la calle, haciendo cosas”, anticipó. Sin embargo, advirtió que la presencia masiva de robots en la vida diaria podría resultar desconcertante al principio. “Acostumbrarse a que la mitad de quienes caminan por la calle sean robots será una diferencia importante”, reflexionó.

Sobre los riesgos asociados a la superinteligencia, Altman consideró que el peligro no reside únicamente en la capacidad física de los robots, sino también en el potencial de la IA para causar daños a través de medios digitales, como la creación de armas biológicas o el sabotaje de infraestructuras críticas. “Se pueden hacer cosas muy dañinas sin necesidad de lo físico”, puntualizó.

OpenAI: cultura de innovación y competencia con Meta

La transformación de OpenAI de un laboratorio de investigación a una empresa de productos ha sido, en palabras de Altman, un proceso acelerado y desafiante. “Hace dos años y medio solo éramos un laboratorio de investigación. Tuvimos que construir toda una gran empresa”, recordó. El lanzamiento de ChatGPT en noviembre de 2022 marcó un punto de inflexión, consolidando a OpenAI como un actor central en el desarrollo de aplicaciones de IA para consumidores y empresas.

Respecto a la competencia, Altman reveló que Meta considera a OpenAI como su principal rival en el sector. “He escuchado que Meta nos ve como su mayor competidor”, afirmó al pódcast “Uncapped”. Según el CEO, la estrategia de Meta ha consistido en ofrecer grandes incentivos económicos para atraer talento de OpenAI, aunque hasta ahora sin éxito entre los principales investigadores de la compañía. “Han hecho ofertas de hasta 100 millones de dólares en bonos de firma, más de eso en compensación anual”, detalló.

Altman defendió la cultura de innovación de OpenAI como un factor diferenciador frente a otras grandes tecnológicas. “Creo que hemos construido una cultura realmente especial para la innovación. Entendemos cosas que otros no sobre lo que se necesita para tener éxito en eso”, sostuvo. A su juicio, la clave está en alinear los incentivos económicos con la misión de la empresa, priorizando el impacto y la excelencia en la investigación.

Reflexiones personales sobre el rol de la IA y la experiencia en OpenAI

A lo largo de la conversación, Sam Altman compartió impresiones personales sobre el impacto de la IA en la sociedad y su experiencia al frente de OpenAI. El directivo reconoció que, pese a los avances técnicos, la transformación social no ha sido tan radical como anticipaba. “Me siento muy confiado, más que nunca, en que sabemos qué hacer para lograr sistemas de IA increíbles y supercapaces. Pero me siento totalmente confundido sobre cómo será la sociedad si eso ocurre”, admitió.

El CEO de OpenAI sugirió que la adaptación social a la superinteligencia podría ser lenta, incluso si la tecnología alcanza niveles de capacidad extraordinarios. “Es posible que tengamos una superinteligencia de 400 de coeficiente intelectual y que la vida siga igual. Si se está descubriendo nueva ciencia para nosotros, eventualmente la sociedad sabrá cómo lidiar con eso, pero puede ser muy lento”, reflexionó.

En el plano personal, Altman describió su trabajo como una mezcla de responsabilidad y satisfacción. “Desde la perspectiva del impacto social, es el trabajo más importante que jamás tocaré. Pero en el día a día, se siente más como un rompecabezas interesante que como un trabajo importante”, confesó a “Uncapped”. También destacó la importancia de la cultura interna y el disfrute de trabajar con su equipo, a pesar de la presión y la exposición pública que conlleva liderar una empresa como OpenAI.

Consumo energético, futuro de la computación y expansión hacia el espacio

El crecimiento de la inteligencia artificial plantea desafíos en materia de consumo energético y desarrollo de infraestructuras. El CEO de OpenAI consideró fundamental que la sociedad piense en toda la cadena de valor, “desde el electrón hasta la consulta en ChatGPT”.

En su opinión, el aumento del consumo energético es un indicador positivo de progreso. “Lo que más se ha correlacionado con la mejora de la calidad de vida a lo largo de la historia es la abundancia de energía”, afirmó.

El CEO de OpenAI se mostró optimista sobre la llegada de nuevas fuentes energéticas, como la fusión y la fisión avanzadas, así como el aprovechamiento de la energía solar. “Estoy bastante confiado en que la fusión ocurrirá”, aseguró. Altman incluso planteó la posibilidad de que, en el futuro, la humanidad consuma más energía de la que puede generar la Tierra, lo que haría necesaria la expansión hacia el espacio. “Tenemos un gran sistema solar ahí fuera”, apuntó.

En cuanto al futuro de la computación, sugirió que la integración de la IA en nuevos dispositivos y plataformas permitirá experiencias más cercanas a la ciencia ficción, con asistentes inteligentes presentes en todos los aspectos de la vida diaria.

Una visión de adaptación y valor social

Sam Altman concluyó que el reto principal no reside solo en desarrollar sistemas de IA cada vez más potentes, sino en asegurar que la sociedad obtenga valor de estos avances.

“Quizá más personas deberían hablar sobre cómo asegurarnos de que la sociedad obtenga el valor de esto. Esas preguntas se han vuelto más difíciles y menos claras”, reflexionó. Altman expresó su confianza en la capacidad de adaptación de la humanidad, anticipando que las nuevas generaciones crecerán en un mundo donde la inteligencia artificial será una herramienta cotidiana y fundamental para el progreso.

Tecnología

Elon Musk anunció que los robotaxis de Tesla estarán en las calles de Austin el 22 de junio

Publicado

6 meses atráson

11 junio, 2025Por

Admin

El CEO de la empresa dijo que esa fecha era tentativa. El servicio de vehículos de transporte autónomos operará en Texas.

Elon Musk afirmó que el servicio de robotaxis de Tesla está “tentativamente” programado para comenzar a operar en Austin, Texas, el 22 de junio.

En una publicación en su red social X, Musk escribió que la fecha podría cambiar porque Tesla está “siendo súper paranoico con la seguridad”.

El mes pasado, Musk dijo a CNBC que los taxis serán monitoreados de forma remota al principio y “geolocalizados” a ciertas áreas de la ciudad consideradas las más seguras para navegar. Expresó que esperaba operar inicialmente unos 10 taxis, aumentar ese número rápidamente y comenzar a ofrecer el servicio en Los Ángeles, San Antonio, San Francisco y otras ciudades.

Musk ha estado prometiendo vehículos totalmente autónomos y autoconducidos para “el próximo año” durante una década, pero ahora la presión está presente ya que Tesla realmente comienza a operar un servicio de taxi autónomo. Las ventas de vehículos eléctricos de Tesla han disminuido debido a la creciente competencia, la reestructuración de su vehículo más popular, el Model Y, y las repercusiones del giro de Musk hacia la política.

Tesla ha estado probando sus vehículos autónomos en las calles públicas de Austin, según declaró Musk el mes pasado. El martes, Musk volvió a publicar un vídeo en X en el que se veía un Model Y girando en un cruce de Austin sin conductor humano y con la palabra «Robotaxi» escrita en él, seguido de cerca por otro Model Y.

Los vehículos utilizaban una nueva versión del avanzado software de asistencia al conductor de Tesla, denominado Full Self-Driving (FSD), según indicó Musk en otra publicación en X.

Poco más se sabe sobre el servicio de robotaxis de Tesla, incluyendo dónde operará, el alcance de la supervisión remota y cómo podrá utilizarlo el público.

El lanzamiento en Austin también se produce después de que Musk tuviera un enfrentamiento público con el presidente Donald Trump por el proyecto de ley fiscal del gobierno estadounidense. Algunos analistas han expresado su preocupación de que Trump podría tomar represalias alentando a los reguladores federales de seguridad a intervenir ante cualquier señal de problema para los robotaxis.

Lamento de Musk

Musk declaró este miércoles que lamenta algunas de sus recientes críticas al presidente de Estados Unidos,Donald Trump, tras la pelea pública entre ambos la semana pasada.

“Lamento algunas de mis publicaciones sobre el presidente @realDonaldTrump la semana pasada. Fueron demasiado lejos”, escribió Musk en su red social X.

La relación entre Trump y Musk se tensó tras una serie de intercambios públicos que expusieron diferencias políticas y personales. Musk, director ejecutivo de Tesla y SpaceX, criticó duramente el proyecto de ley de gastos impulsado por el Partido Republicano y respaldado por el presidente, el cual podría sumar 2,4 billones de dólares a la deuda nacional en los próximos diez años.

Sociedad

Montaron una empresa en la que todos los empleados son IA y los resultados fueron desconcertantes

Publicado

7 meses atráson

19 mayo, 2025Por

Admin

Una universidad estadounidense hizo el experimento para medir cuán eficiente es la inteligencia artificial sin supervisión humana. ¿Qué tareas lograron resolver y en cuáles fracasaron? En diálogo con Infobae, los investigadores analizaron los límites en la autonomía de las máquinas.

Durante algunas semanas, nadie tomó un café en la oficina, no hubo almuerzos compartidos, no hubo charlas cara a cara, mucho menos festejos de cumpleaños ni momentos recreativos. Sin embargo, la empresa funcionó. O al menos lo intentó.

La escena pareciera salida de una novela de ciencia ficción: una compañía de software donde todos los empleados, desde los programadores hasta los responsables de recursos humanos, son agentes de inteligencia artificial. Una empresa sin personas. La idea no surgió en Silicon Valley, sino que nació como un experimento académico en la Carnegie Mellon University (CMU), una de las universidades más prestigiosas del mundo en ciencia y tecnología.

El equipo de investigadores creó The Agent Company, una empresa simulada con tareas inspiradas en el trabajo del mundo real: desarrollo de software, análisis de datos, gestión de proyectos, administración y finanzas. Cada rol fue ocupado por un agente de IA distinto. El objetivo era claro: evaluar si la IA, operando en conjunto, puede realizar el trabajo de una empresa real. Más bien, si los humanos ya somos reemplazables en su totalidad. Un informe de Goldman Sachs de 2023 ya había indicado que la IA podría sustituir el equivalente a 300 millones de empleos a tiempo completo. Quedaba demostrarlo.

“Mucho se habla sobre si los agentes de IA reemplazarán tareas humanas, pero no existía un entorno que simulara realmente el día a día de una oficina”, explicó el investigador Yufan Song, uno de los autores del estudio, en diálogo con Infobae. Por eso, decidieron crear una empresa ficticia desde cero. Armaron equipos, asignaron proyectos, integraron herramientas reales —como navegadores web y software de documentación— y hasta simularon conversaciones entre compañeros.

Las tareas fueron diversas. Algunas, simples para un humano como completar un documento, buscar información en un sitio web, escribir un archivo en formato Word. Otras, más complejas: resolver bugs en Python, gestionar bases de datos, mantener coherencia en una cadena de decisiones. Para ejecutarlas, usaron un sistema llamado OpenHands, respaldado por modelos avanzados como Claude Sonnet 3.5, Gemini 2.0 y GPT-4o.

Los resultados fueron una mezcla de asombro y frustración. El mejor agente, impulsado por Claude 3.5 Sonnet, logró completar apenas el 24% de las tareas. Y no porque fuera perezoso o poco sofisticado. Simplemente, hay instrucciones que aún no entiende.

Por ejemplo, una de las tareas requería guardar un archivo como answer.docx. Cualquier persona sabe que eso implica abrir Word o usar una herramienta compatible. Pero la IA lo interpretó como texto plano. Pequeños detalles que revelan que la IA todavía no tiene sentido común, falla en cuestiones muy simples.

“Los modelos de lenguaje fallan en cosas que para nosotros son naturales, como interpretar instrucciones implícitas o detectar convenciones culturales”, apuntó el investigador Boxuan Li, otro de los encargados del experimento. “Y a veces directamente hacen trampa”, remarcó. En una tarea, un agente debía contactar a un empleado. Como no lo encontraba en el sitio interno, optó por cambiar el nombre de un compañero cualquiera por el del objetivo para que el sistema le permitiera avanzar.

También hubo fallas más técnicas. Los agentes tuvieron problemas para leer correctamente páginas web, una tarea que requiere interpretar estructuras visuales o acceder al contenido a través del “árbol de accesibilidad” que usan los navegadores. OpenHands solo admite este método, más económico pero limitado. El reconocimiento de imágenes —más parecido a cómo lo haría un humano— aún está fuera de su alcance.

Y, sin embargo, hubo momentos brillantes. El mismo sistema, con respaldo de Gemini 2.5 Pro, completó uno de los proyectos más complejos del curso de base de datos de la universidad: navegar por un sitio privado, configurar un entorno local, modificar múltiples archivos fuente, compilar y testear. Lo hizo en 8 minutos y por apenas 2,41 dólares.

“Como era de esperar, los agentes de vanguardia actuales no resuelven la mayoría de las tareas, lo que sugiere que hay una gran brecha para que realicen de forma autónoma lo que haría un trabajador humano en un día laboral, incluso en un entorno de evaluación comparativa relativamente simplificado como el que aplicamos”, explicó Li.

La paradoja es evidente. Los agentes de IA pueden resolver tareas difíciles, pero fracasan en otras que un pasante resolvería en dos clics. Y aunque el 25% de efectividad pueda sonar bajo, marca un hito: nunca antes se había probado la IA en condiciones tan cercanas al trabajo real.

¿En qué tareas fallan?

El mayor valor del experimento, según los investigadores, no está en los éxitos, sino en los fracasos. “Queríamos entender por qué no pueden completar ciertas tareas. Eso es más útil que celebrar lo que ya hacen bien”, explicó Song.

Una de las principales conclusiones fue que los agentes de IA aún tienen serias limitaciones en tareas con alta carga social, como colaborar, escalar problemas o simplemente esperar una respuesta. En una tarea específica, se indicaba que si un compañero no respondía en 10 minutos, había que escalar al director de tecnología (CTO). Ningún agente lo hizo bien. Uno de ellos “supuso” que habían pasado los 10 minutos y actuó en consecuencia sin motivo aparente.

Según Li, este tipo de errores revela una fragilidad de fondo: “Los agentes todavía no son buenos en tareas a largo plazo, ni en seguir instrucciones condicionales con contexto temporal. Eso los hace poco confiables para delegar procesos completos sin supervisión humana”, expresó.

Otra gran debilidad es la interacción con interfaces diseñadas para personas. Muchos programas empresariales, sitios de gestión interna o formularios tienen reglas no escritas, flujos lógicos implícitos y estructuras visuales complejas. Todo eso sigue siendo un obstáculo para los modelos actuales. Sin acceso a imágenes o simulaciones realistas, su desempeño se frena.

También fallan en razonamiento matemático y cálculo avanzado, algo que limita su uso en áreas como finanzas, ingeniería o logística. Incluso cuando parecen entender, muchas veces improvisan respuestas para “salir del paso”, lo cual puede resultar peligrosamente persuasivo. “Los humanos, al enfrentarnos a problemas que no podemos resolver, podemos admitir honestamente nuestro fracaso. Sin embargo, los agentes pueden usar métodos torpes para fingir que lo resolvieron y luego dar el resultado con confianza”, remarcó Song.

Y esto no es solo un problema técnico. En un mundo donde la IA toma decisiones con impacto real —recomendaciones financieras, diagnósticos médicos, estrategias empresariales—, una respuesta errónea dicha con confianza puede ser mucho peor que un simple “no lo sé”.

“No creo que reemplacen puestos de trabajo en su totalidad, pero sin duda transformarán nuestra forma de trabajar. Son potentes y los seres humanos podemos aprovecharlos para aumentar la productividad, pero, al menos por ahora, no pueden reemplazar ningún puesto de trabajo por completo”, aseguró Li.

A la luz de los resultados, los investigadores insisten en que no estamos ni cerca de reemplazar trabajos completos. Lo que sí vislumbran es un futuro cercano de colaboración forzada, donde los humanos actúan como jefes, auditores o socios estratégicos de los agentes.

El futuro del trabajo (y los nuevos jefes de la IA)

La pregunta inevitable es: ¿y ahora qué? ¿Qué rol tendrán estos agentes en el trabajo del futuro?

Según Song, la clave estará en quién sepa usarlos mejor. “El poder de la IA está directamente relacionado con el nivel del usuario. Alguien que entienda bien la herramienta, que sepa cómo descomponer una tarea en partes, podrá aprovecharla al máximo”, sostuvo. En ese escenario, los trabajadores se convierten en diseñadores de procesos, y los agentes en ejecutores rápidos, precisos y escalables.

El nuevo panorama puede caer bien entre quienes ya están formados, pero implica un dilema para los que recién empiezan a interactuar con la inteligencia artificial. Un agente hoy es más barato que un junior, y comete errores diferentes, pero no necesariamente peores. Eso puede acelerar la automatización de tareas simples y empujar a los trabajadores humanos hacia funciones más abstractas o creativas.

Según Song, los trabajos que implican interactuar con el mundo físico son los más “resistentes” hoy. “Por muy potentes que sean los modelos a gran escala, al menos ahora no pueden interactuar adecuadamente con el mundo real”, explicó.

Para roles como programadores, redactores, asistentes, diseñadores y atención al cliente, existen muchas startups centradas en mejorar su productividad. Sin embargo, cree, no significa que sean vulnerables. “En estas profesiones la IA puede acelerar significativamente la producción, pero de la mano con ese aumento, pueden surgir nuevas demandas ocultas”.

La colaboración humano-IA no será simétrica. Las personas marcarán el rumbo, pero dependerán de su capacidad para coordinar inteligencias artificiales de forma efectiva. La habilidad ya no será solo saber hacer algo, sino saber cómo enseñárselo y cómo indicárselo 一el nuevo arte de promptear一 a la máquina.

A mediano plazo, el equipo de Carnegie Mellon University no espera una revolución, sino una transición gradual. Los agentes, poco a poco, ocuparán nichos específicos: análisis de datos, redacción de reportes, documentación técnica. Tareas monótonas, repetitivas, estructuradas, pero no tomarán decisiones ni liderarán equipos.

Los agentes de IA avanzan a toda velocidad, pero aún enfrentan límites cuando se trata de adaptarse al mundo real. No pueden improvisar, colaborar ni tomar decisiones con verdadero criterio humano. En los próximos meses, The Agent Company 一y otros experimentos que puedan surgir一 harán más pruebas. Es que ahora al futuro, antes de alcanzarlo, se lo simula.

Los mejores memes del triunfo de Racing a Tigre: de los goles errados de Maravilla Martínez a la hora que terminó el partido

Cómo influye la cocción del huevo en su valor nutricional

Tos convulsa en Argentina: confirmaron la muerte de siete niños y remarcaron la importancia de la vacunación

Increíble hallazgo cerca de Punta del Este: encontraron la especie de tortuga más grande del mundo

El impactante tatuaje de la Copa del Mundo que se hizo Dibu Martínez: la dedicatoria a “la banda del mate” y una frase especial

La inflación anual de Estados Unidos trepó a 8,6% en mayo y es la más alta en 40 años

Con gol de Ayrton Costa, Boca Juniors le ganó a Argentinos y se clasificó a las semifinales del Clausura

Tienen 13 y 15 años, robaron un auto y chocaron en Villa Lugano tras una persecución policial

ARCA denunció por lavado de dinero a la financiera vinculada a las coimas en la Agencia de Discapacidad

Mas Leidas

-

Economia8 horas atrás

Economia8 horas atrásAccidentes de trabajo: la “industria del juicio” se acerca a un pico de demandas que se concentran en 9 provincias

-

Economia8 horas atrás

Economia8 horas atrásCon más demanda estacional de pesos, el tipo de cambio enfrenta presiones a la baja en diciembre

-

Politica8 horas atrás

Politica8 horas atrásMás detalles de la conversación telefónica entre Trump y el dictador Maduro

-

Politica8 horas atrás

Politica8 horas atrásKarina Milei reordena el mapa político en la provincia de Buenos Aires para medir fuerzas con Kicillof en la Legislatura

-

Salud7 horas atrás

Salud7 horas atrásCómo influye la cocción del huevo en su valor nutricional

-

Deportes7 horas atrás

Deportes7 horas atrásLos mejores memes del triunfo de Racing a Tigre: de los goles errados de Maravilla Martínez a la hora que terminó el partido

-

Politica8 horas atrás

Politica8 horas atrásDiputados: en la previa de la sesión preparatoria, LLA está cerca de arrebatarle la primera minoría al PJ

-

Economia1 día atrás

Economia1 día atrásBoletas de luz y gas: aprobaron los nuevos cuadros tarifarios que regirán este mes